El aumento de los deepfakes criminales: fraude, pornografía y suplantación de identidad

Los deepfakes se utilizan para fraudes, suplantación de identidad y pornografía no consentida, advierten expertos en ciberseguridad global.

En los últimos años, la inteligencia artificial (IA) ha transformado la manera en que las personas interactúan con el mundo, pero también ha abierto nuevas puertas para la actividad criminal.

Los deepfakes, videos o audios falsificados mediante IA, han tenido un aumento en su uso con fines ilegales, como la pornografía no consentida, estafas y suplantación de identidad, alertan expertos en ciberseguridad.

Several posts on X have spread awareness of pornographic deepfake sites created for female K-pop idols.

— BitMind | Bittensor Subnet 34 τ (@BitMindAI) September 24, 2024

One website, in particular, has a directory with pornographic deepfakes of over 100 female idols from nearly every generation of K-Pop (including several 5th gen groups).… pic.twitter.com/GA3v2vWakz

También te podría interesar: Video “fake” de Kamala Harris compartido por Elon Musk desata polémica por uso de IA

El Cyberpeace Institute, una organización especializada en ciberamenazas, informó que el uso de deepfakes en la pornografía se duplica cada seis meses en las plataformas de streaming más populares.

A la vez, el fraude basado en esta tecnología se multiplicó por diez entre 2022 y 2023, afectando a diversas industrias. Según Stéphane Duguin, CEO de la organización,

Un asombroso 96% de estos videos están relacionados con pornografía no consentida, incluyendo extorsión y explotación infantil”

Los rostros de las víctimas son superpuestos en videos explícitos sin su autorización, lo que convierte a los deepfakes en herramientas devastadoras para la explotación personal.

¿Cuáles son las prácticas criminales de las deepfakes?

Estafas financieras y suplantación de identidad

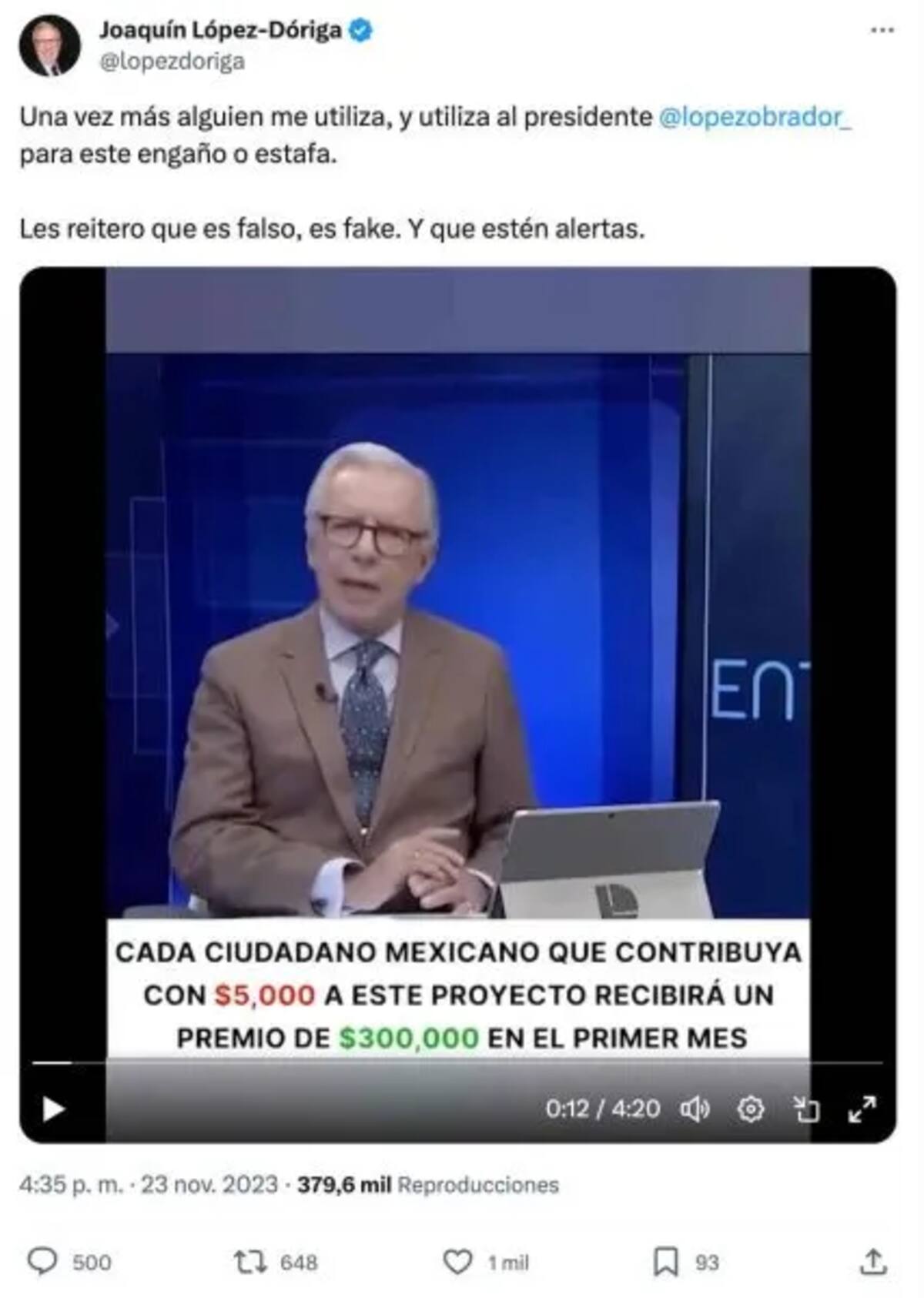

El uso de deepfakes también ha llegado al ámbito financiero. Un informe de Unit 42, división de la firma de ciberseguridad Palo Alto Networks, reveló que bandas organizadas están utilizando imágenes de celebridades para crear campañas fraudulentas de inversión.

Un ejemplo reciente es la plataforma Quantum AI, que utilizó la imagen de figuras como Elon Musk y Andrés Manuel López Obrador para atraer víctimas hacia esquemas de inversión falsos. Los criminales emplean videos legítimos manipulados con IA, añadiendo audio falso para hacer que los labios coincidan con los diálogos creados.

Estas estafas funcionan solicitando datos personales como nombre y teléfono, para luego contactar a la víctima y solicitar pagos iniciales de alrededor de 250 dólares. A través de aplicaciones falsas, los delincuentes muestran pequeñas ganancias iniciales para ganarse la confianza de la víctima, pero eventualmente bloquean su acceso a los fondos y se apropian del dinero invertido.

También te podría interesar: Investigan a Telegram por “contribuir” a la distribución de contenido deepfake sexualmente explícito en línea

La respuesta de los gobiernos: ¿es suficiente?

Aunque los gobiernos de todo el mundo están empezando a legislar sobre el uso de la IA, los expertos coinciden en que estas medidas aún son insuficientes.

En 2023, la Unión Europea aprobó la Ley de Inteligencia Artificial, que establece controles sobre las tecnologías de IA, incluyendo los deepfakes, para garantizar la transparencia. Sin embargo, Raquel Jorge, investigadora del Real Instituto Elcano, señala que

El reglamento necesita ser codificado para asegurar que todos los estados lo puedan aplicar, especialmente en ámbitos como las estafas generadas por IA”

Por su parte, Kyle Wilhoit, director de investigación de amenazas en Unit 42, advierte que el uso de deepfakes se está volviendo cada vez más sofisticado, replicando antiguas estafas con un nuevo enfoque tecnológico.

Los delincuentes ahora pueden clonar voces para engañar a las víctimas, haciéndose pasar por familiares o conocidos cercanos”

— afirma Wilhoit

Esta técnica es particularmente efectiva en fraudes de suplantación de identidad, que han afectado tanto a individuos como a empresas.

Fraude documental y su impacto en el crimen organizado

Otra área de preocupación creciente es el uso de deepfakes para manipular documentos de identidad. Los delincuentes han utilizado esta tecnología para modificar pasaportes y eludir sistemas de reconocimiento facial, lo que facilita actividades criminales como el tráfico de personas o la inmigración ilegal.

El fraude documental avanzado está ganando terreno, amplificando el riesgo de delitos transnacionales”

— explica Duguin

Además, los expertos han detectado la aparición de “empleados deepfake”, una modalidad en la que los ciberdelincuentes se hacen pasar por trabajadores reales, utilizando datos personales robados para acceder a información corporativa confidencial.

También te podría interesar: ¿Qué son las deepfakes?: Impulsan iniciativas tras estar expuestos el 69% de usuarios en México

¿Qué sigue para este desafío cibernetico?

El futuro del fraude deepfake

A medida que las técnicas de deepfakes se vuelven más sofisticadas, los sistemas de seguridad tradicionales, incluidos los métodos biométricos, también están siendo vulnerados. Stéphane Duguin señala que

La biometría de voz y facial ya está en riesgo, ya que los deepfakes son capaces de generar videos dinámicos y audios que pueden engañar a estos sistemas”

Ante este panorama, los expertos en ciberseguridad coinciden en que la lucha contra el fraude deepfake apenas comienza.

Las soluciones pasan por mejorar las tecnologías de detección y fortalecer las legislaciones que regulan el uso de IA para proteger tanto a individuos como a empresas de estos ataques cada vez más complejos y peligrosos.

Sigue nuestro canal de WhatsApp

Recibe las noticias más importantes del día. Da click aquí

Te recomendamos

WhatsApp activa una función para descubrir si hay intrusos en tu cuenta y bloquearlos al instante desde tu celular, para evitar fraudes con el código de verificación

Meta eliminará cuentas falsas tras denuncias de fraude luego que se denunciara la presencia de perfiles utilizados para estafar a usuarios, especialmente migrantes

La nueva CURP biométrica ya opera en módulos de RENAPO, pero el trámite, que dura de 15 a 20 minutos, aún no es obligatorio ni es exclusivo para adultos mayores con INAPAM

Ya es oficial: estas serían las consecuencias si no registras tu línea antes del 30 de junio; así afectará tu señal, llamadas y datos móviles

Grupo Healy © Copyright Impresora y Editorial S.A. de C.V. Todos los derechos reservados

Grupo Healy © Copyright Impresora y Editorial S.A. de C.V. Todos los derechos reservados