Si alguien usó Inteligencia Artificial para crear una imagen tuya desnudo (o de tu hijo/a); así es cómo puedes reportarla y eliminarla de internet

Herramientas y rutas legales para eliminar contenido íntimo creado sin tu consentimiento.

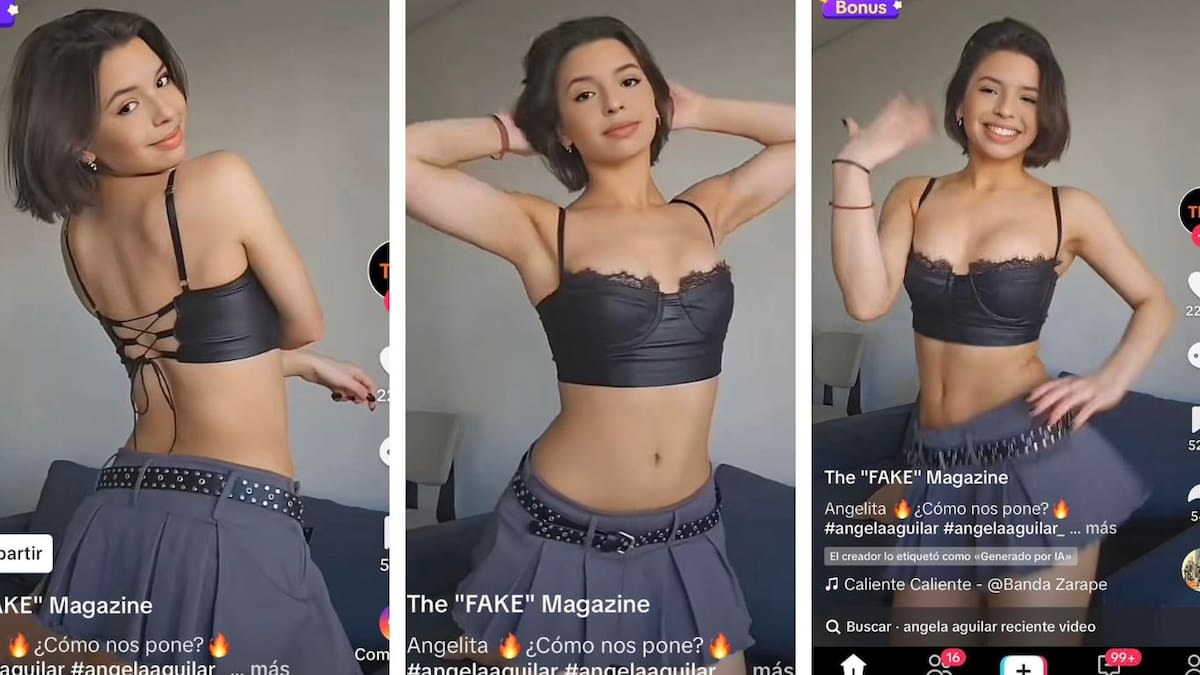

CIUDAD DE MÉXICO.- La difusión de imágenes íntimas sin consentimiento, ya sean reales, modificadas o creadas con inteligencia artificial, se ha convertido en un problema grave y cada vez más frecuente. Hoy es posible que una persona sea víctima de un montaje digital, conocido como deepfake, que simula desnudos o situaciones sexuales que nunca ocurrieron. Ante esta amenaza, existen herramientas y procedimientos para recuperar el control y retirar ese material de la red.

De acuerdo con información difundida por las plataformas StopNCII y el National Center for Missing & Exploited Children (NCMEC), es posible rastrear y eliminar este tipo de contenido con un alto nivel de efectividad.

En esta nota le explicamos, paso a paso, qué hacer si usted o su hijo han sido víctimas de esta práctica.

Tal vez te interese: Investigan a Telegram por “contribuir” a la distribución de contenido deepfake sexualmente explícito en línea

Tal vez te interese: Melania Trump apoya ley contra la pornografía ‘deepfake’ generada con IA

¿Qué hacer si circula una imagen íntima sin tu permiso?

Si descubre que una fotografía suya o de un menor ha sido manipulada y compartida sin autorización, lo más importante es actuar con rapidez. Estos son los pasos recomendados por las organizaciones especializadas:

- Descargue la imagen problemática: Guarde en su dispositivo la foto o el video que desea eliminar de internet. Será necesaria para iniciar el proceso.

- Ingrese a la plataforma correcta

- Si la imagen corresponde a un adulto, utilice el sitio: https://stopncii.org

- Si se trata de un menor de edad, ingrese a: https://takeitdown.ncmec.org/es

- Abra un caso y suba el archivo: En estas páginas podrá crear un reporte y cargar la imagen. Las plataformas no almacenan el contenido, solo lo usan para generar una huella digital.

- Se crea un “hash” o huella digital: A partir de la imagen, se genera un código único que permite identificarla sin necesidad de conservar el archivo original.

- Distribución del hash a empresas tecnológicas: Ese identificador se envía a plataformas colaboradoras como Instagram, Facebook, TikTok, X, Microsoft Bing y sitios de contenido para adultos.

- Retiro del material y seguimiento: Las empresas proceden a localizar y eliminar la imagen y le informan los resultados del proceso.

Según los datos de estas organizaciones, el sistema tiene una efectividad cercana al 90 por ciento. En los últimos diez años se han eliminado más de 200 mil imágenes íntimas individuales difundidas sin consentimiento.

La inteligencia artificial no es un juego

El avance de la inteligencia artificial ha traído beneficios importantes en áreas como la medicina, la educación y la investigación científica. Sin embargo, también ha abierto la puerta a nuevos riesgos que afectan directamente a niños, adolescentes y adultos.

Especialistas como Guillermo Cánovas, autor del análisis “Mira con quién hablan. La inteligencia artificial ¿es segura para nuestros hijos?”, advierten que es necesario entender que estas herramientas no son inofensivas. Pueden parecer asistentes amigables y confiables, pero funcionan bajo algoritmos complejos que toman decisiones de manera autónoma y, en muchos casos, impredecible.

Cánovas explica que la IA actúa según pautas definidas por sus desarrolladores, pero tiene capacidad para aprender y adaptarse.

Lo que nosotros hicimos fue diseñar el algoritmo de aprendizaje. Es más o menos como diseñar el principio de la evolución. Pero cuando este algoritmo de aprendizaje interactúa con datos, produce complicadas redes neuronales que son efectivas para hacer cosas, pero no entendemos con certeza cómo hace esas cosas”, ha reconocido Geoffrey Hinton, Premio Nobel de Física y pionero en inteligencia artificial.

Tal vez te interese: Deepfake más sofisticadas que nunca: estafas con voz clonada por inteligencia artificial van en aumento

Tal vez te interese: Reportan en Sonora 32 casos de “deepfake sexual” hecho con inteligencia artificial; todas las víctimas son niñas y mujeres jóvenes

Riesgos que deben conocer las familias

El uso cotidiano de herramientas como ChatGPT, Deepseek o Claude plantea desafíos que padres y docentes deben tener presentes:

1. Impacto en el desarrollo cognitivo

El uso constante de IA puede afectar habilidades como el pensamiento crítico, la resolución de problemas y la autonomía. Los menores pueden acostumbrarse a recibir respuestas inmediatas sin realizar un esfuerzo propio.

2. Pérdida de privacidad cognitiva

Aunque algunas aplicaciones aseguran no guardar conversaciones, en la práctica suelen almacenar información. Un niño que comparte sus miedos o inquietudes con una IA está entregando datos personales muy sensibles.

3. Falsa sensación de autoridad

Los jóvenes tienden a creer que todo lo que responde una IA es verdad. Sin embargo, estas herramientas pueden equivocarse, inventar información o presentar datos sesgados.

4. Fraude académico

Entregar tareas realizadas completamente por inteligencia artificial no es plagio, pero sí un engaño. Esto puede generar problemas escolares y normalizar conductas deshonestas.

5. Información sesgada

Las respuestas de la IA se basan en contenidos de internet que pueden contener prejuicios ideológicos, culturales o sociales. No siempre ofrecen una visión objetiva.

6. Acceso a contenido inapropiado

Estas plataformas no verifican la edad del usuario. Un menor puede recibir respuestas sobre temas para los que no está preparado.

7. Riesgo de adicción

La personalización y la interacción constante pueden generar dependencia emocional, especialmente en adolescentes.

8. Dificultad para distinguir la verdad

La IA permite crear noticias, fotos y videos falsos que parecen reales. Esto facilita engaños, difamaciones y acoso digital.

Educación digital, la mejor protección

El problema no es la tecnología en sí, sino el uso que se le da. Las herramientas de inteligencia artificial pueden ser valiosas si se utilizan con criterio, supervisión y límites claros.

Por eso, los expertos recomiendan hablar abiertamente con los hijos sobre los riesgos, enseñarles a verificar información y establecer reglas para el uso responsable de estas plataformas.

Si usted es víctima de un montaje o difusión de imágenes íntimas, recuerde que no está solo. Existen mecanismos para protegerle y eliminar ese contenido. Actuar con rapidez, denunciar y utilizar las herramientas adecuadas puede marcar la diferencia.

La inteligencia artificial seguirá avanzando. Prepararnos para usarla de forma ética y segura es una tarea que involucra a familias, escuelas y sociedad en general.

Tal vez te interese: Crean herramienta que detecta fotografías ‘deepfake’ con una efectividad del 94%

Sigue nuestro canal de WhatsApp

Recibe las noticias más importantes del día. Da click aquí

Te recomendamos

Spotify lanza nueva función de IA para crear listas personalizadas: usuarios premium en EEUU y Canadá ahora pueden controlar su música y configurar reglas diarias

El mundo frena la ‘IA humana’: China e Indonesia imponen leyes para que los algoritmos dejen de simular emociones y bloqueen la adicción de los usuarios tras dos horas de uso

Reino Unido investiga a X por uso de Grok para crear deepfakes sexuales

La nueva estafa con Inteligencia Artificial que vacía cuentas bancarias en 2026: Cómo identificar la clonación de voz de familiares y cuáles son los nuevos seguros obligatorios que protegen tu ahorro según la CNBV

Grupo Healy © Copyright Impresora y Editorial S.A. de C.V. Todos los derechos reservados

Grupo Healy © Copyright Impresora y Editorial S.A. de C.V. Todos los derechos reservados