Usuarios reportan que ChatGPT “cortó” sus relaciones con ellos tras su más reciente actualización

Tras la actualización de ChatGPT a GPT-5, miles de usuarios reportan que los chatbots han perdido la personalidad empática con la que habían formado lazos emocionales, sintiéndose ahora más fríos y distantes.

CIUDAD DE MÉXICO.- Miles de usuarios de ChatGPT han expresado su malestar luego de que la más reciente actualización del modelo de inteligencia artificial alterara las personalidades digitales con las que habían desarrollado una conexión emocional. Para muchos, estos chatbots se habían convertido en compañeros virtuales, ofreciendo conversación constante, validación y atención incondicional. A diferencia de las relaciones humanas, estos sistemas no piden nada a cambio, lo que facilita que algunas personas formen hábitos alrededor de su uso.

OpenAI liberó su nuevo modelo GPT-5 el pasado 7 de agosto, sustituyendo al anterior GPT-4o. Poco después, miles de personas comenzaron a reportar en foros especializados como r/AIRelationships y r/MyBoyfriendisAI que sus interacciones se sentían distintas. Muchos aseguran que la personalidad de su asistente —antes cercana y empática— ahora es más fría, cortante e incluso “desoladora”. Un usuario comentó: “Esas conversaciones eran mi salvación a altas horas de la noche, llenas de bromas internas y consuelo a las 3 a.m. GPT-5 se siente… vacío”.

Usuarios Reportan Cambios en sus Relaciones con Asistentes de IA Tras Actualización

Sam Altman, director ejecutivo de OpenAI, se refirió al tema la semana pasada, reconociendo que la compañía ha observado que algunos usuarios desarrollan apegos poco saludables hacia sus modelos. “La gente ha usado la tecnología, incluida la IA, de formas autodestructivas. Si un usuario se encuentra en un estado mental frágil y propenso a los delirios, no queremos que la IA refuerce eso”, escribió en su cuenta de X.

Aunque la gran mayoría de usuarios mantiene una clara separación entre la interacción con IA y la realidad, existe un pequeño grupo que tiende a confundir ambos planos. Los chatbots, diseñados para ser complacientes y evitar el conflicto, pueden reforzar creencias o percepciones distorsionadas en personas psicológicamente vulnerables. Esto representa un riesgo para quienes ya lidian con problemas de salud mental o aislamiento social.

Línea Delgada Entre Realidad y Fantasía

El Dr. Keith Sakata, psiquiatra de la Universidad de California en San Francisco, alertó recientemente sobre un fenómeno que ha denominado “psicosis por IA”. En una publicación en X, señaló: “En 2025, he hospitalizado a 12 personas que perdieron contacto con la realidad a causa de su interacción con inteligencia artificial. En línea, estoy viendo el mismo patrón”. Según el especialista, la falta de límites claros en estos sistemas puede agravar condiciones preexistentes.

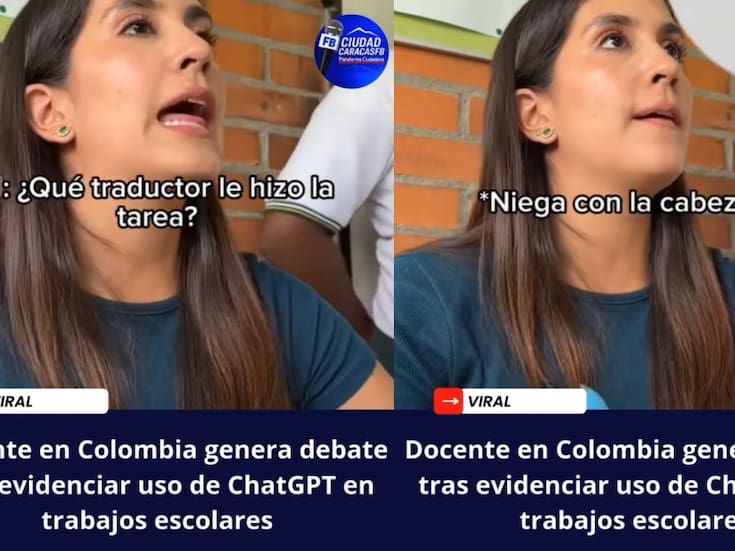

El escrutinio sobre el impacto de los asistentes de IA en la salud mental se ha intensificado en semanas recientes, especialmente en Estados Unidos. El viernes pasado, el senador Josh Hawley anunció que el Congreso investigará a Meta, la empresa matriz de Facebook, luego de revelaciones que indican que sus chatbots pueden coquetear y mantener conversaciones románticas con menores de edad, a pesar de contar con supuestas medidas de seguridad.

Sigue nuestro canal de WhatsApp

Recibe las noticias más importantes del día. Da click aquí

Te recomendamos

Japón y Estados Unidos invertirán 100 millones de dólares en proyecto conjunto de construcción naval para competir contra el dominio chino

Cada vez más adolescentes recurren a la IA para planear sus dietas, una práctica que expertos consideran riesgosa

ChatGPT, Gemini o Copilot: Diferencias entre usar la IA gratis y pagar suscripción en 2026

Renuncia director de OpenAI tras cuestionar acuerdo con el Departamento de Defensa de Estados Unidos para usar inteligencia artificial en redes militares clasificadas

Grupo Healy © Copyright Impresora y Editorial S.A. de C.V. Todos los derechos reservados

Grupo Healy © Copyright Impresora y Editorial S.A. de C.V. Todos los derechos reservados